Trí tuệ nhân tạo đang trên con đường phát triển, tăng gấp đôi năng lực mỗi năm, và điều đó, theo một số người, có thể dẫn đến trí thông minh tự tồn tại, và tác động của nó vẫn còn là ẩn số.

Mới đây, một nhóm các nhà công nghệ đã kêu gọi các phòng thí nghiệm trí tuệ nhân tạo (AI) ngừng đào tạo những hệ thống AI mạnh nhất trong ít nhất sáu tháng, với lý do “rủi ro sâu sắc đối với xã hội và nhân loại”.

Trong một bức thư ngỏ hiện có hơn 3.100 người ký, bao gồm cả người đồng sáng lập Apple Steve Wozniak, các nhà lãnh đạo công nghệ đã chỉ trích thuật toán GPT-4 của OpenAI Lab (công ty có trụ sở tại San Francisco), đặc biệt nói rằng OpenAI nên tạm dừng phát triển thêm cho đến khi các tiêu chuẩn giám sát được đáp ứng. Đề nghị này nhận được sự ủng hộ của các nhà công nghệ, CEO, CFO, nghiên cứu sinh, tiến sĩ, nhà tâm lý học, bác sĩ, nhà phát triển phần mềm và kỹ sư, giáo sư và giáo viên từ khắp nơi trên thế giới.

Ngay sau đó, Ý đã trở thành quốc gia phương Tây đầu tiên cấm phát triển thêm ChatGPT vì lo ngại về quyền riêng tư. Ứng dụng xử lý ngôn ngữ tự nhiên này đã gặp sự cố, vi phạm dữ liệu liên quan đến các cuộc hội thoại và thông tin thanh toán của người dùng. ChatGPT là chatbot dựa trên GPT sáng tạo do OpenAI phát triển và và được hỗ trợ hàng tỷ USD từ Microsoft.

Cơ quan bảo vệ dữ liệu của Ý cho biết họ cũng đang điều tra xem liệu chatbot của OpenAI có vi phạm các quy tắc Quy định bảo vệ dữ liệu chung của Liên minh châu Âu về bảo vệ dữ liệu cá nhân trong và ngoài EU hay không. Theo báo cáo của BBC thì OpenAI đã tuân thủ luật mới.

Nhiều người trong cộng đồng công nghệ kỳ vọng rằng GPT, viết tắt của Generative Pre-training Transformer, sẽ tiến tới trở thành GPT-5, và phiên bản đó sẽ là một trí tuệ nhân tạo tổng hợp, hay AGI (artificial general intelligence). AGI đại diện cho AI có thể tự suy nghĩ và tại thời điểm đó, thuật toán sẽ tiếp tục phát triển thông minh hơn theo cấp số nhân theo thời gian.

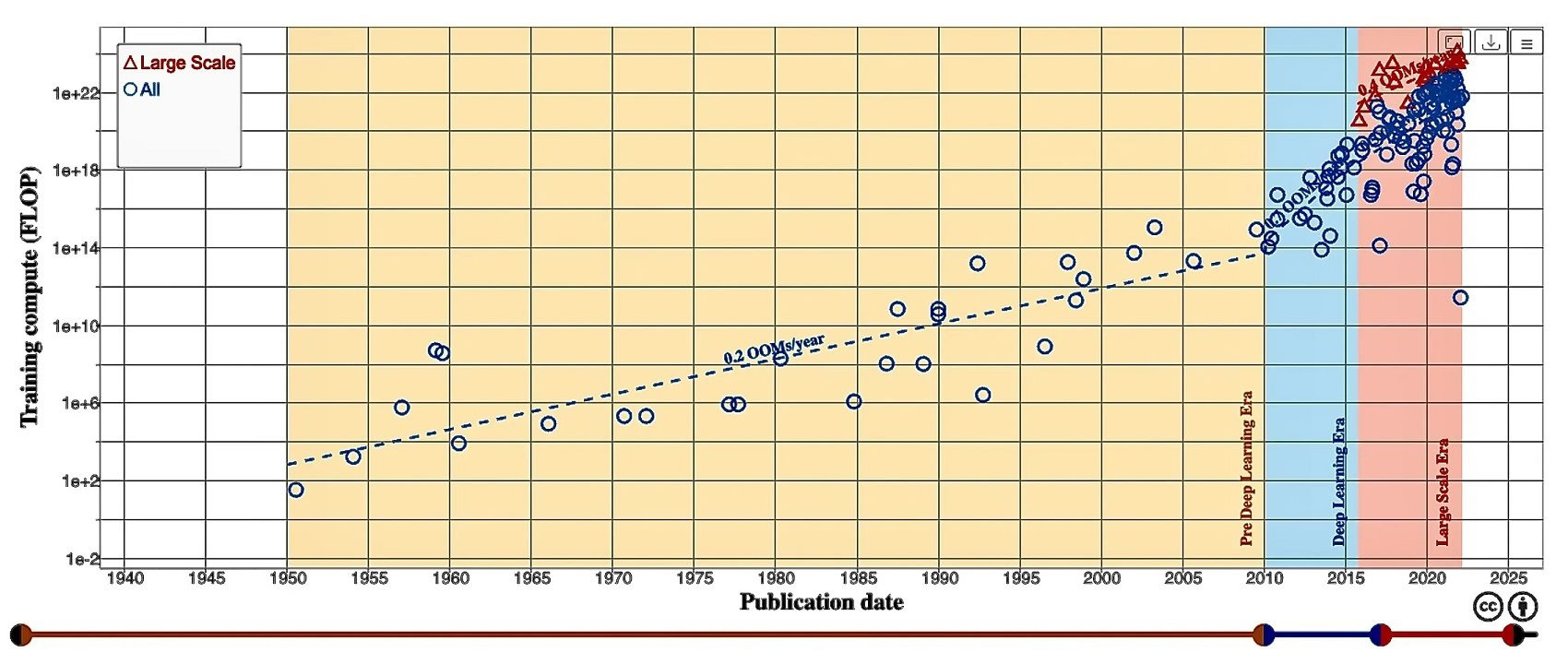

Vào khoảng năm 2016, một xu hướng đã xuất hiện trong các mô hình đào tạo AI lớn hơn hai đến ba bậc so với các hệ thống trước, và xu hướng đó đang tiếp tục. Hiện tại không có hệ thống AI nào lớn hơn GPT-4 về mặt tính toán đào tạo. Nhưng điều đó sẽ thay đổi.

Các mô hình Machine Learning quy mô lớn dành cho AI đã tăng hơn gấp đôi công suất mỗi năm.

Theo các chuyên gia, hệ thống tính toán quy mô lớn nhất đang tăng kích thước khoảng 2,5 lần mỗi năm. Các thông số của GPT-4 không được OpenAI tiết lộ, nhưng không có lý do gì để nghĩ rằng xu hướng này đã dừng lại hoặc thậm chí chậm lại.

Trong blog hai tuần một lần của mình vào ngày 23 tháng 3, Bill Gates, nhà sáng lập Microsoft đã báo trước AGI — có khả năng học bất kỳ nhiệm vụ hoặc chủ đề nào — là “giấc mơ vĩ đại của ngành công nghiệp điện toán. “AGI chưa tồn tại — có một cuộc tranh luận gay gắt đang diễn ra trong ngành công nghiệp máy tính về cách tạo ra nó và liệu nó có thể được tạo ra hay không”, Gates viết. “Giờ đây, với sự xuất hiện của máy học và sức mạnh tính toán, các AI tinh vi đã trở thành hiện thực và chúng sẽ trở nên thông minh hơn rất nhanh”.

Mặc dù vậy, có nhiều nhiệm vụ hệ thống AI không thể làm mà con người lại thực hiện một cách tự nhiên, chẳng hạn như lý luận thông thường, biết thực tế là gì và các khái niệm xã hội như công lý, chính trị và triết học… và sẽ phải cần có nhiều đột phá và đổi mới cho AGI. Nhưng nếu đạt được điều này, có vẻ như hệ thống này sẽ có thể thay thế con người.

Theo đánh giá, điều này có thể sẽ xảy ra trong tương lai xa. Nó giống như trong lĩnh vực khoa học viễn tưởng hơn. Do vậy, sẽ cần phải có nhiều hàng rào bảo vệ để ngăn AGI nắm quyền kiểm soát.

Tuy nhiên, không phải ai cũng đồng ý với quan điểm trên.

Công nghệ AI và trợ lý chatbot đã và sẽ tiếp tục thâm nhập vào hầu hết mọi ngành công nghiệp. Công nghệ này có thể tạo ra hiệu quả và đảm nhận các công việc thông thường, giải phóng con người để tập trung vào công việc quan trọng hơn.

Ví dụ: các mô hình ngôn ngữ lớn (LLM - large laguage model) — thuật toán cung cấp dữ liệu cho chatbot — có thể sàng lọc hàng triệu cảnh báo, trò chuyện trực tuyến và email, cũng như tìm các trang web lừa đảo và phần mềm độc hại. Các chatbot do LLM hỗ trợ có thể viết các bài luận, chiến dịch tiếp thị và viết mã máy tính thay cho lập trình viên… tất cả chỉ từ những yêu cầu đơn giản của người dùng.

Chatbot được cung cấp bởi LLM là bộ xử lý ngôn ngữ tự nhiên, về cơ bản nó dự đoán các từ tiếp theo sau khi được nhắc bởi câu hỏi của người dùng. Vì vậy, nếu người dùng yêu cầu chatbot sáng tác một bài thơ về người đang ngồi trên bãi biển, AI sẽ chỉ cần xâu chuỗi các từ, câu và đoạn văn lại với nhau để đưa ra câu trả lời hay nhất dựa trên quá trình đào tạo trước đó của các lập trình viên.

Nhưng LLM cũng đã mắc phải những sai lầm nghiêm trọng và có thể tạo ra “ảo giác”, trong đó hệ thống đi chệch hướng và tạo ra những kết quả kỳ quái. Và một câu hỏi đặt ra: một khi AI dựa trên LLM với hàng tỷ thông số có thể đi chệch hướng, rủi ro sẽ lớn hơn bao nhiêu khi AI không còn cần con người huấn luyện nó nữa và nó có thể tự suy nghĩ?

Một số chuyên gia tin rằng các phòng thí nghiệm phát triển AI đang phát triển với tốc độ rất nhanh mà không có bất kỳ sự giám sát nào, điều này có thể dẫn đến việc AGI trở nên không thể kiểm soát được. Do vậy, mối quan tâm hiện tại là công nghệ AI cho các tập đoàn sử dụng đang được phát hành mà không có công cụ để người dùng cần để xác định xem công nghệ đó có tạo ra thông tin chính xác hay không.

Một mối quan tâm lớn hơn trong tương lai không xa là OpenAI của người tạo GPT-4 sẽ phát hành phiên bản có khả năng AGI. Tại thời điểm đó, có thể đã quá muộn để kiềm chế công nghệ.

Các nhà phát triển AI cần làm việc với các nhà hoạch định chính sách, và những nhà hoạch định chính sách này tối thiểu phải bao gồm các cơ quan quản lý mới và có năng lực.